Коэффициент корреляции Пирсона

Линейный корреляционный анализ позволяет установить прямые связи между переменными величинами по их абсолютным значениям. Формула расчета коэффициента корреляции построена таким образом, что если связь между признаками имеет линейный характер, коэффициент Пирсона точно устанавливает тесноту этой связи. Поэтому он называется также коэффициентом линейной корреляции Пирсона.

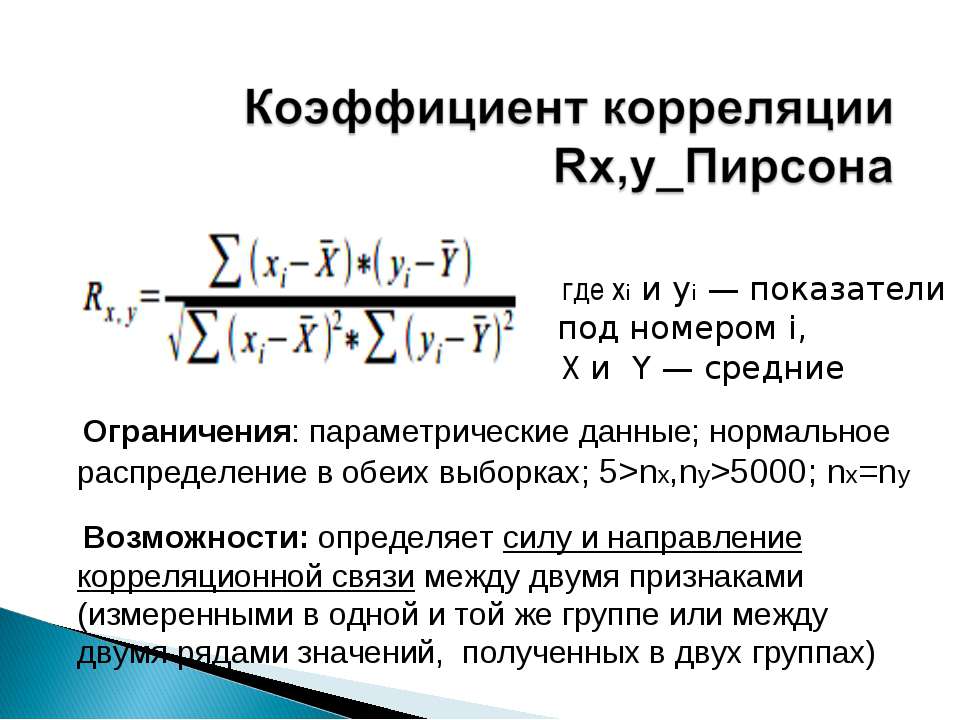

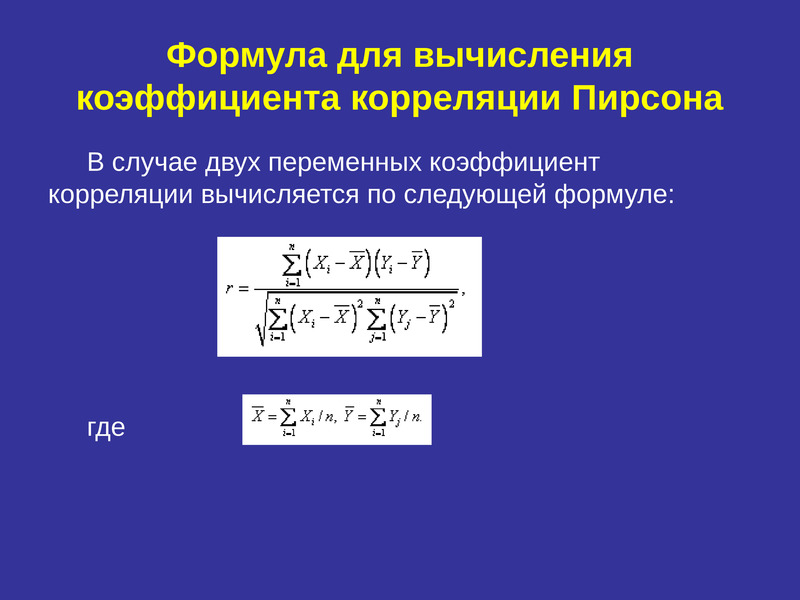

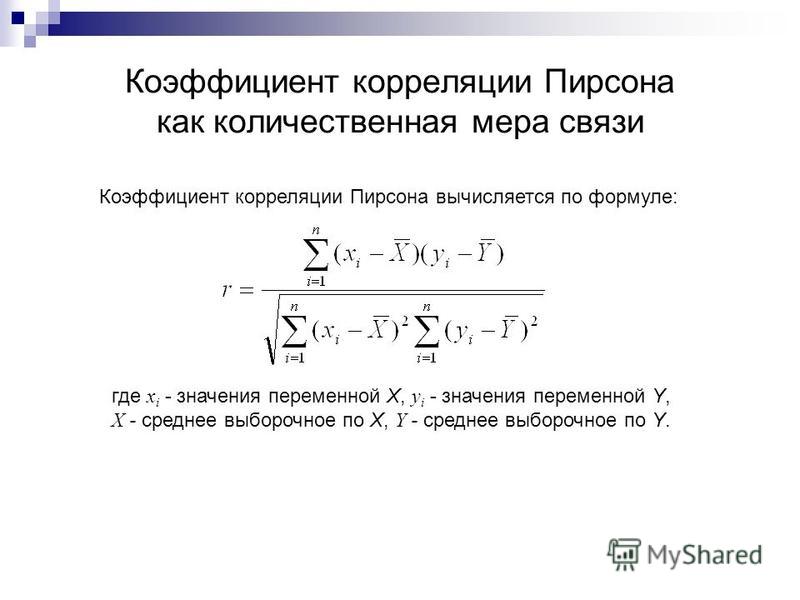

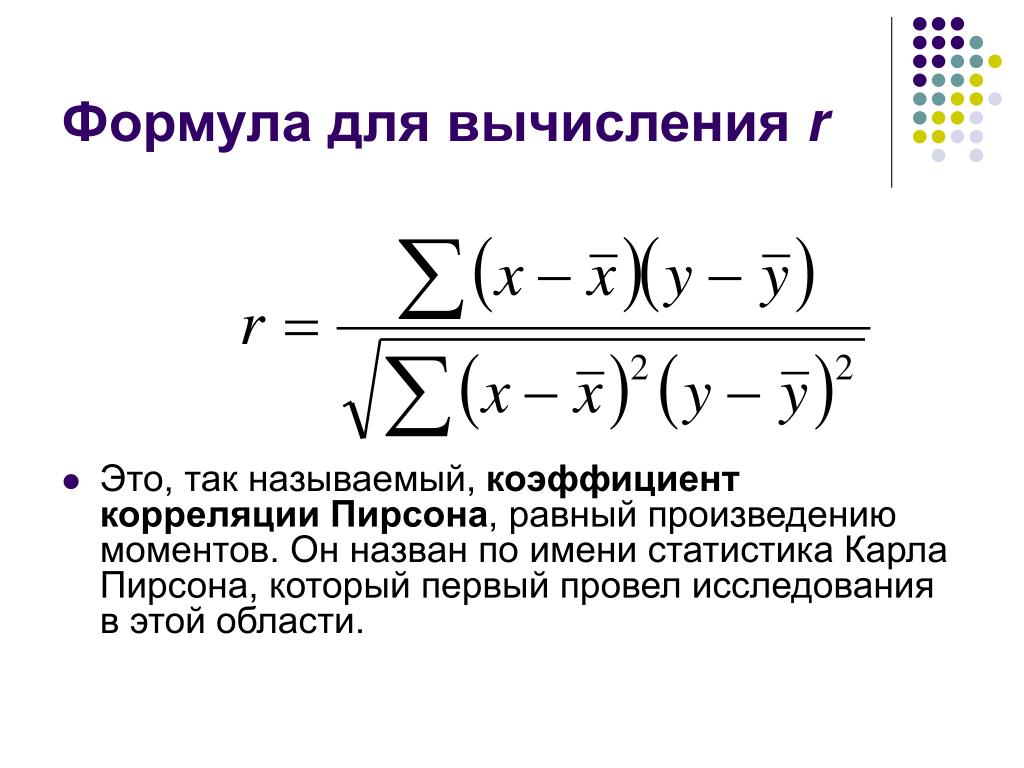

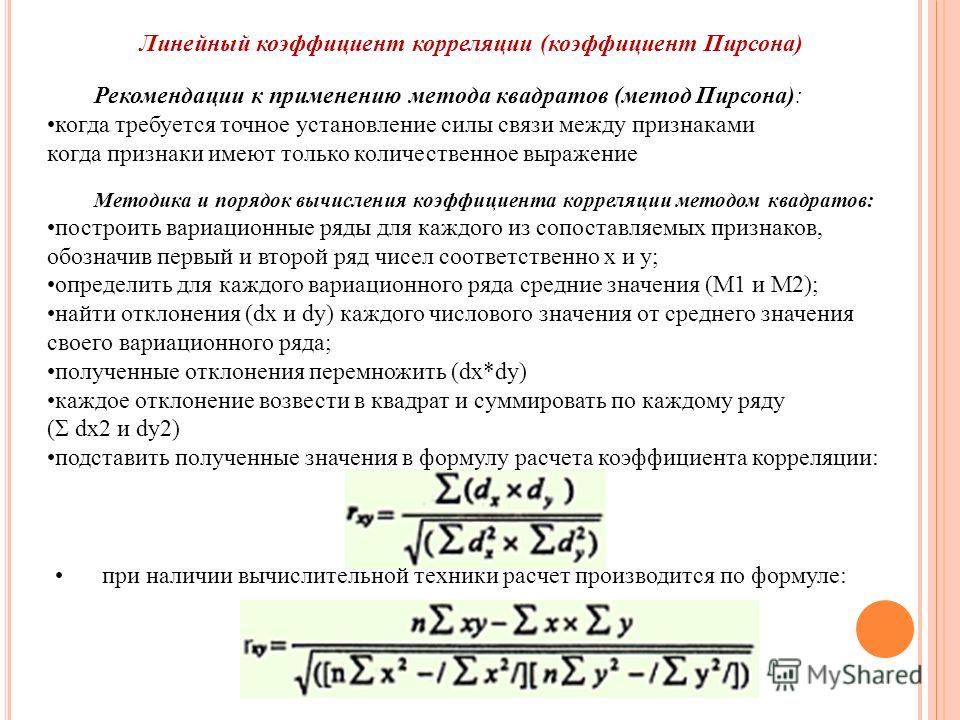

В общем виде формула для подсчета коэффициента корреляции такова:

где — значения, принимаемые переменной X,

— значения, принимаемые переменой Y,

— средняя по X,

— средняя по Y.

Расчет коэффициента корреляции Пирсона предполагает, что переменные и распределены нормально.

Даная формула предполагает, что из каждого значения переменной X, должно вычитаться ее среднее значение . Это не удобно, поэтому для расчета коэффициента корреляции используют не данную формулу, а ее аналог, получаемый с помощью преобразований:

Используя данную формулу, решим следующую задачу:

Пример:

20 школьникам были даны тесты на

наглядно-образное и вербальное мышление. Измерялось среднее время решения заданий

теста в секундах. Психолога интересует

вопрос: существует ли взаимосвязь между

временем решения этих задач? Переменная

X — обозначает среднее время решения

наглядно-образных, а переменная Y —

среднее время решения вербальных заданий

тестов.

Измерялось среднее время решения заданий

теста в секундах. Психолога интересует

вопрос: существует ли взаимосвязь между

временем решения этих задач? Переменная

X — обозначает среднее время решения

наглядно-образных, а переменная Y —

среднее время решения вербальных заданий

тестов.

Для решения данной задачи представим исходные данные в виде табл. 12, в которой введены дополнительные столбцы, необходимые для расчета по формуле

В табл. 12 даны индивидуальные значения переменных X и Y, построчные произведения переменных X и Y, квадраты переменных всех индивидуальных значений переменных X и Y, а также суммы всех вышеперечисленных величин.

Таблица 12

№ испытуемых | X | Y | X Y | X X | Y Y |

| Среднее время решения наглядно-образных заданий | Среднее время решения вербальных заданий |

|

|

|

1 | 19 | 17 | 323 | 361 | 289 |

2 | 32 | 7 | 224 | 1024 | 49 |

3 | 33 | 17 | 561 | 1089 | 289 |

4 | 44 | 28 | 1232 | 1936 | 784 |

5 | 28 | 27 | 756 | 784 | 729 |

6 | 35 | 31 | 1085 | 1225 | 961 |

7 | 39 | 20 | 780 | 1521 | 400 |

8 | 39 | 17 | 663 | 1521 | 289 |

9 | 44 | 35 | 1540 | 1936 | 1225 |

10 | 44 | 43 | 1892 | 1936 | 1849 |

11 | 24 | 10 | 240 | 576 | 100 |

12 | 37 | 28 | 1036 | 1369 | 784 |

13 | 29 | 13 | 377 | 841 | 169 |

14 | 40 | 43 | 1720 | 1600 | 1849 |

15 | 42 | 45 | 1890 | 1764 | 2025 |

16 | 32 | 24 | 768 | 1024 | 5760 |

17 | 48 | 45 | 2160 | 2304 | 2025 |

18 | 42 | 26 | 1092 | 1764 | 676 |

19 | 33 | 16 | 528 | 1089 | 256 |

20 | 47 | 26 | 1222 | 2209 | 676 |

Сумма | 731 | 518 | 20089 | 27873 | 16000 |

Рассчитываем эмпирическую величину коэффициента корреляции по формуле:

Определяем

критические значения для полученного

коэффициента корреляции по табл.

Отметим, что в табл. 19 приложения 6 величины критических значений коэффициентов линейной корреляции Пирсона даны по абсолютной величине. Следовательно, при получении как положительного, так и отрицательного коэффициента корреляции по формуле оценка уровня значимости этого коэффициента проводится по той же таблице приложения без учета знака, а знак добавляется для дальнейшей интерпретации характера связи между переменными X и Y.

При нахождении критических значений для вычисленного коэффициента корреляции Пирсона число степеней свободы рассчитывается как .

В нашем случае k = 20, поэтому n — 2 = 20 — 2 = 18. В первом столбце табл. 19 приложения 6 в строке, обозначенной числом 18, находим :

0,44 для P 0,05

0,56 для P 0,01

Строим соответствующую «ось значимости»:

Ввиду

того, что величина расчетного коэффициента

корреляции попала в зону значимости

— отвергается

и принимается гипотеза .

Иными словами, связь между временем

решения наглядно-образных и вербальных

задач статистически значима на 1% уровне

и положительна.

Для применения коэффициента корреляции Пирсона, необходимо соблюдать следующие условия:

Сравниваемые переменные должны быть получены в интервальной шкале или шкале отношений.

Распределения переменных X и Y должны быть близки к нормальному.

Число варьирующих признаков в сравниваемых переменных X и Y должно быть одинаковым.

Таблицы уровней значимости для коэффициента корреляции Пирсона (таблица 19 приложения 6) рассчитаны от n = 5 до n = 1000. Оценка уровня значимости по таблицам осуществляется при числе степеней свободы k = n — 2.

Корреляционная

матрица представляет

собой симметричную квадратную матрицу

размером M*M,

где М –

число исследуемых факторов, главная

диагональ которой заполнена единицами

(или нулями для удобства дальнейшего

анализа), а недиагональные элементы

представляют собой меру тесноты связи

между парой факторов (коэффициент

корреляции, корреляционное отношение,

модифицированный индекс Фехнера и

т. д.). Другими словами, для заполнения

корреляционной матрицы необходимо

найти меру тесноты связи для каждой

пары факторов, то есть, провести

корреляционный анализ таблицы исходных

данных по принципу «каждый с каждым»

любым известным способом (например, по

методу Чебышева).

д.). Другими словами, для заполнения

корреляционной матрицы необходимо

найти меру тесноты связи для каждой

пары факторов, то есть, провести

корреляционный анализ таблицы исходных

данных по принципу «каждый с каждым»

любым известным способом (например, по

методу Чебышева).

На

практике часто встречаются случаи

грубых промахов парных выборок, выявить

которые очень сложно, а также заметные

отклонения факторов от нормального

закона распределения. Применение в этих

условиях классического корреляционного

анализа с мерой тесноты связи в виде

коэффициента корреляции требует

известной осторожности, так как на фоне

большого рассеивания исходных данных

нелегко решить, принадлежит ли конкретная

пара чисел исследуемой двумерной

совокупности или представляет собой

грубый промах. В сомнительных случаях

(обе случайные величины не распределены

по нормальному закону распределения;

есть подозрение, что парная выборка

может содержать грубые промахи)

рекомендуется в качестве меры тесноты

связи использовать модифицированный

индекс Фехнера.

Непосредственный

анализ корреляционной матрицы представляет

значительную трудность, так как

корреляционные связи между факторами

образуют деревья, цепи, циклы и другие

фигуры графов. Для выделения главных

зависимостей сдует прибегнуть к одному

из методов анализа таких матриц,

простейшим из которых является метод

корреляционных плеяд.

Метод заключается в том, что в корреляционной матрице находится недиагональный элемент с максимальной по модулю величиной |

Результат такой работы удобно представить на рисунке в виде графа, вершинами которого являются факторы, ребрами – максимальные связи, причем длины ребер обратно пропорционально величине соответствующей коэффициентов корреляции. Выбрав некоторое пороговое значение коэффициента корреляции, например |rпор|=0.5, можно отделить по этому признаку плеяды друг от друга.

Внутри

каждой плеяды связь между факторами

признается тесной, а между плеядами –

слабой. Это означает, что если от каждой

плеяды выбрать по одному представителю,

то новое общее количество факторов,

сокращенное до количества плеяд, будет

нести об исследуемом объекте практически

ту же информацию, что и раньше. При этом

факторы новой таблицы данных будут

слабо коррелированными между собой,

что является одним из главных условий

перехода к математическому моделированию.

Это означает, что если от каждой

плеяды выбрать по одному представителю,

то новое общее количество факторов,

сокращенное до количества плеяд, будет

нести об исследуемом объекте практически

ту же информацию, что и раньше. При этом

факторы новой таблицы данных будут

слабо коррелированными между собой,

что является одним из главных условий

перехода к математическому моделированию.

Корреляционная матрица — таблица, в которой представлены коэффициенты корреляции между всеми исследуемыми переменными.

2. Структурограмма — форма графического представления результатов корреляционного анализа взаимосвязи переменных, являющихся частью психологической структуры или системы (компоненты психологической структуры интеллекта, компоненты психологической системы деятельности, компоненты структуры профессионально важных качеств и т.п.).

3.

Коррелограмма (корреляционная плеяда) —

форма графического представления

результатов корреляционного анализа

взаимосвязи переменных, не являющихся

частью психологической структуры или

системы на уровне качественного анализа

или теоретических представлений того

или иного ученого.

Файлы-примеры:

1. Файл SPSS 42 ДЗ.

2. Файл SPSS 43 ДЗ.

3. Файл SPSS 44 ДЗ.

4. Файл SPSS 45 ДЗ.

Результат выполнения заданий: умение интерпретировать и представлять результаты корреляционного анализа в виде корреляционной плеяды.

Интерпретация факторов производится по таблице факторных нагрузок после вращения (таблица «Матрица повернутых компонент») в следующем порядке:

1. По каждой переменной (строке) выделяется наибольшая по абсолютной величине нагрузка — как доминирующая. Если вторая по величине нагрузка в строке отличается от уже выделенной менее чем на 0,2, то и она выделяется, но как второстепенная.

2.

После просмотра всех строк — переменных,

просмотрите столбцы — факторы. По каждому

фактору выписывают

наименования (обозначения) переменных,

имеющих наибольшие нагрузки по этому

фактору. При этом обязательно учитывается

знак факторной нагрузки переменной:

если знак отрицательный, это отмечается

как противоположный полюс фактора. 3.

После такого просмотра всех факторов

каждому из них присваивается наименование,

обобщающее по смыслу включенные в него

переменные.

3.

После такого просмотра всех факторов

каждому из них присваивается наименование,

обобщающее по смыслу включенные в него

переменные.

Если трудно подобрать термин из соответствующей теории, допускается наименование фактора по имени переменной, имеющей по сравнению с другими наибольшую нагрузку по этому фактору.

Пример описания результатов ФА:

Корреляционные плеяды

Все чаще и чаще от студентов требуют в курсовых и дипломных работах строить корреляционные плеяды (корреляционные графы). Плеяды становятся неотъемлемой частью корреляционного исследования, необходимым условием того, что работа будет благосклонно принята научным руководителем и успешно пройдет защиту.

Данная

тенденция, очевидно, связана с тем, что

сейчас не составляет особого труда

рассчитывать огромные корреляционные

матрицы, отвечающие за взаимосвязи

между исследуемыми параметрами. Множество

найденных корреляций не всегда легко

описать, сложно выделить важное и

отбросить лишнее. Зачастую подсчитав

корреляции, сложно понять с чего начать,

собственно, анализ результатов. И тут,

как нельзя, кстати, пришлись корреляционные

плеяды, которые позволяют графически

отобразить все многообразие взаимосвязей.

О плеядах вспомнили те преподаватели

и профессора, которые выросли на них,

для которых они являются привычными.

Они используют корреляционные плеяды

в своих научных работах, зачастую

вручную рисуя их на бумажке ручкой или

карандашом, как это делали еще полвека

назад.

Зачастую подсчитав

корреляции, сложно понять с чего начать,

собственно, анализ результатов. И тут,

как нельзя, кстати, пришлись корреляционные

плеяды, которые позволяют графически

отобразить все многообразие взаимосвязей.

О плеядах вспомнили те преподаватели

и профессора, которые выросли на них,

для которых они являются привычными.

Они используют корреляционные плеяды

в своих научных работах, зачастую

вручную рисуя их на бумажке ручкой или

карандашом, как это делали еще полвека

назад.

Пример таких плеяд, можно увидеть, например, тут:

По сути, корреляционные плеяды – это способ отображения информации о корреляциях, который помогает их структурировать, проводить объединение коррелирующих факторов.

Здесь

стоит сделать небольшое отступление,

и рассказать об учебном процессе: еще

десятилетие назад никакой такой сложной

статистики не требовали от студентов.

С начала появления компьютеров в широком

использовании, с ростом возможностей

текстовых редакторов и электронных

таблиц, студенту вполне хватало

сравнительного анализа табличных

данных, а до компьютерной эры не

требовалось и того – достаточно

было одного лишь описания частных

случаев, выявления тенденций «на глазок».

Билет26

Статистический критерий — строгое математическое правило, по которому принимается или отвергается та или иная статистическая гипотеза с известным уровнем значимости. Построение критерия представляет собой выбор подходящей функции от результатов наблюдений (ряда эмпирически полученных значений признака), которая служит для выявления меры расхождения между эмпирическими значениями и гипотетическими.

4.2.1. Исследование линейных корреляций по Пирсону, Спирману и Кендалу |

Сначала мы рассмотрим пример применения коэффициента корреляции Пирсона. Предположим, что у нас есть ответы респондентов на следующие два вопроса. Каков Ваш среднемесячный доход в расчете на одного члена семьи? с вариантами ответа:

■ до $100;

■ от $ 100 до $ 300;

■ от $ 300 до $ 600;

■ от $ 600 до $ 1000;

■ от $ 1000 до $ 1500;

■ свыше $1500.

Как часто Вы посещаете рестораны? с вариантами ответа:

■ более 1 раза в день;

■ примерно 1 раз в день;

■ 2-3 раза в неделю;

■ примерно 1 раз в неделю;

■ 2-3 раза в месяц;

■ примерно 1 раз в месяц;

■ реже 1 раза в месяц.

В результате ввода в компьютер заполненных анкет респондентов были получены две переменные: q3 (первый вопрос) и q28 (второй вопрос). Необходимо установить, зависит ли частота посещения ресторанов от дохода респондентов, и если да, то каким образом. В связи с тем, что в ходе опроса при ответе на каждый вопрос респондентам предлагалось на выбор несколько вариантов ответа, тип шкалы у полученных переменных получился порядковым (в файле данных есть только коды ответов, но не сами числовые значения, отражающие частоту посещения ресторана или уровень дохода).

Далее мы рассмотрим не только как использовать коэффициент корреляции Пирсона, но также как использовать данный коэффициент для анализа квазипорядковых переменных. Дело в том, что некоторые переменные, хотя они и закодированы как порядковые, по сути являются интервальными (как в нашем случае). Это делается специально, чтобы, с одной стороны, увеличить долю респондентов, ответивших на вопрос, а с другой стороны, уменьшить число возможных ошибок при вводе в компьютер текстовых полей (для открытых вопросов). Интервалы также полезны при анализе, поскольку нет необходимости кодировать текстовые (или интервальные) переменные, а можно сразу увидеть группы (интервалы) значений. Практика показывает, что подобное составление анкет для маркетинговых исследований является стандартным, поэтому корреляционный анализ редко проводится на изначально интервальных переменных (текстовые поля анкеты).

Интервалы также полезны при анализе, поскольку нет необходимости кодировать текстовые (или интервальные) переменные, а можно сразу увидеть группы (интервалы) значений. Практика показывает, что подобное составление анкет для маркетинговых исследований является стандартным, поэтому корреляционный анализ редко проводится на изначально интервальных переменных (текстовые поля анкеты).

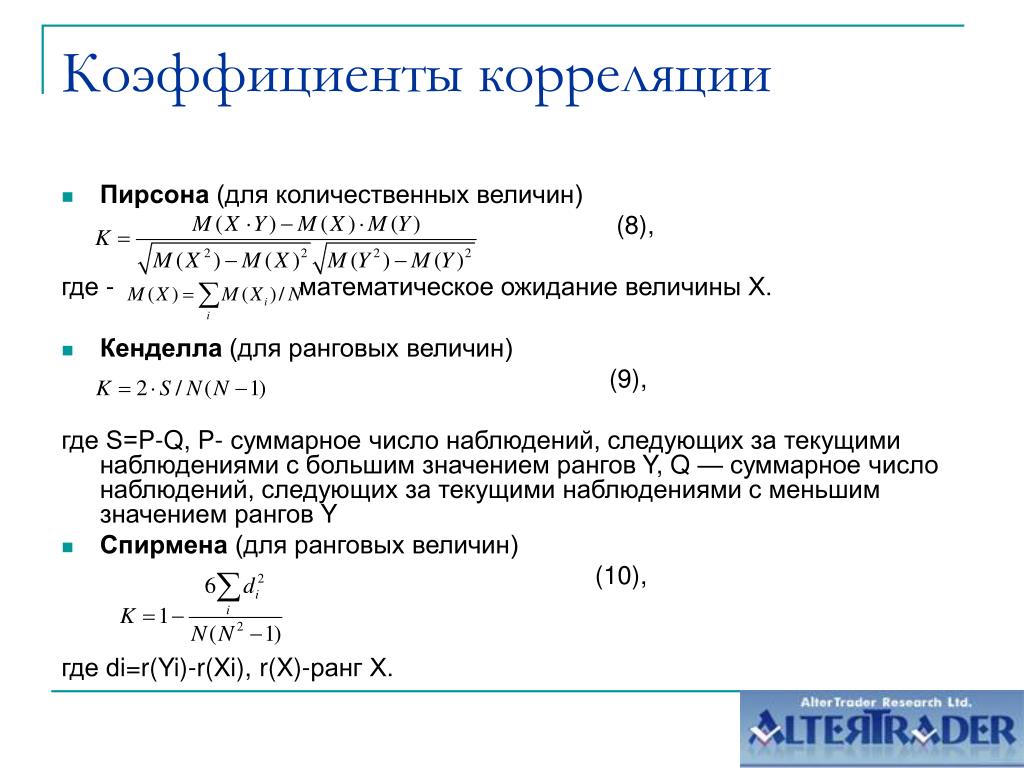

Для описываемых квазипорядковых переменных следует применять именно коэффициент корреляции Пирсона. Использование коэффициентов Спирмана или Кендала в этом случае является некорректным. Более подробно эти два коэффициента представлены ниже; пока же в общих чертах о них можно сказать следующее. Коэффициенты Спирмана или Кендала показывают только степень соответствия порядка следования вариантов ответа в ранжированных списках (есть отсутствие инверсий). При этом корреляции по Спирману и Кендалу используются в основном, когда элементы ранжированных списков представлены мнемоническими, а не числовыми константами. Таким образом, данные коэффициенты не помогут нам в характеристике зависимости между частотой посещения ресторанов и доходом респондентов. Однако в нашем случае нельзя применять и коэффициент корреляции Пирсона, так как в этом случае анализировались бы коды интервалов (1 -6 — в первом вопросе и 1 -7 — во втором), а не действительные ответы респондентов на вопросы1.

Таким образом, данные коэффициенты не помогут нам в характеристике зависимости между частотой посещения ресторанов и доходом респондентов. Однако в нашем случае нельзя применять и коэффициент корреляции Пирсона, так как в этом случае анализировались бы коды интервалов (1 -6 — в первом вопросе и 1 -7 — во втором), а не действительные ответы респондентов на вопросы1.

Итак, сначала мы должны преобразовать имеющиеся у нас порядковые переменные к интервальному виду. Лучше всего сделать это при помощи замены кодов интервалов (1-6) на средние значения данных интервалов. Например, среднее значение для интервала 3 в переменной q3 — это $ 450 (450 = (300 + 600) / 2). Преобразовав обе переменные к данному виду, мы получим следующие интервальные переменные q3_i и q28_i (табл. 4.5)2.

Таблица 4.5. Схема перекодировки порядковых переменных (q3 и q28) в интервальные (q3_i и q28_i)

Порядковые переменные | Интервальные переменные |

Каков Ваш среднемесячный доход в расчете на одного члена семьи? | |

До $ 100 | $50 |

От $ 100 до $ 300 | $200 |

От $ 300 до $ 600 | $450 |

От $ 600 до $ 1000 | $ 800 |

От $ 1000 до $ 1500 | $ 1250 |

Свыше $ 1500 | $ 1750 |

Как часто Вы посещаете рестораны? | |

Более 1 раза в день | 60 раз в месяц |

Примерно 1 раз в день | 30 раз в месяц |

2-3 раза в неделю | 10 раз в месяц |

Примерно 1 раз в неделю | 4 раза в месяц |

2-3 раза в месяц | 2,5 раза в месяц |

Примерно 1 раз в месяц | 1 раз в месяц |

Реже 1 раза в месяц | 0,5 раза в месяц |

Теперь мы можем приступить непосредственно к корреляционному анализу (описанию зависимости между частотой посещения ресторанов и уровнем дохода).

Для этого выберите пункт меню Analyze ► Correlate ► Bivariate. В открывшемся диалоговом окне (рис. 4.17) выберите в левом списке всех доступных переменных две интересующие нас (q3_i и q28_i) и перенесите их в область Variables. Остальные параметры в этом диалоговом окне, установленные по умолчанию, следует оставить неизменными: вывод коэффициентов корреляции Пирсона (параметр Pearson в области Correlation Coefficients) и статистической значимости коэффициентов (параметр Two-tailed в области Test of Significance). Кнопка Options не предлагает исследователю каких-либо существенных параметров. Чтобы запустить процедуру построения корреляционной таблицы, щелкните на кнопке ОК.

Для этого выберите пункт меню Analyze ► Correlate ► Bivariate. В открывшемся диалоговом окне (рис. 4.17) выберите в левом списке всех доступных переменных две интересующие нас (q3_i и q28_i) и перенесите их в область Variables. Остальные параметры в этом диалоговом окне, установленные по умолчанию, следует оставить неизменными: вывод коэффициентов корреляции Пирсона (параметр Pearson в области Correlation Coefficients) и статистической значимости коэффициентов (параметр Two-tailed в области Test of Significance). Кнопка Options не предлагает исследователю каких-либо существенных параметров. Чтобы запустить процедуру построения корреляционной таблицы, щелкните на кнопке ОК.

|

В окне SPSS Viewer появится таблица Correlations с результатами расчетов коэффициента корреляции Пирсона и статистической значимости данного коэффициента. Как видно из рис. 4.18, в нашем случае коэффициент корреляции Пирсона между двумя исследуемыми переменными (q3_i и q28_i) равен +0,665, а его статистическая значимость меньше 0,001. Следовательно, можно сделать вывод о том, что между среднемесячным доходом респондентов и частотой посещения ими ресторанов существует статистически значимая умеренная (средняя) линейная возрастающая зависимость. То есть частота посещения ресторанов в достаточно высокой степени (коэффициент Пирсона = 0,7) зависит от уровня доходов потребителей, причем при росте среднемесячного дохода частота посещения ресторанов линейно возрастает.

Как видно из рис. 4.18, в нашем случае коэффициент корреляции Пирсона между двумя исследуемыми переменными (q3_i и q28_i) равен +0,665, а его статистическая значимость меньше 0,001. Следовательно, можно сделать вывод о том, что между среднемесячным доходом респондентов и частотой посещения ими ресторанов существует статистически значимая умеренная (средняя) линейная возрастающая зависимость. То есть частота посещения ресторанов в достаточно высокой степени (коэффициент Пирсона = 0,7) зависит от уровня доходов потребителей, причем при росте среднемесячного дохода частота посещения ресторанов линейно возрастает.

Существует возможность проводить корреляционный анализ сразу для нескольких переменных. Для этого необходимо поместить эти переменные в область Variables диалогового окна Bivariate Correlations. В таблице Correlations будут показаны коэффициенты корреляции для каждой пары исследуемых переменных.

Теперь рассмотрим процедуру проведения корреляционного анализа при помощи ранговых коэффициентов Спирмана и Кендала. В данных методах одна переменная (эталонная) представлена в виде ранжированной последовательности мнемонических категорий, а другой переменной присваиваются ранговые места. Корреляционные коэффициенты рассчитываются исходя из количества инверсий, то есть числа нарушений порядка следования рангов по сравнению с первым рядом. В большинстве случаев рекомендуется применять коэффициент корреляции Спирмана. Использование коэффициента Кендала оправдано только в том случае, когда в структуре данных имеются выбросы.

В данных методах одна переменная (эталонная) представлена в виде ранжированной последовательности мнемонических категорий, а другой переменной присваиваются ранговые места. Корреляционные коэффициенты рассчитываются исходя из количества инверсий, то есть числа нарушений порядка следования рангов по сравнению с первым рядом. В большинстве случаев рекомендуется применять коэффициент корреляции Спирмана. Использование коэффициента Кендала оправдано только в том случае, когда в структуре данных имеются выбросы.

|

В практике маркетинговых исследований наиболее часто коэффициенты корреляции Спирмана применяются для анализа не всей выборочной совокупности респондентов (базы данных в целом), а агрегированных ранжированных перечней, полученных в результате других преобразований1. Приведем пример. Предположим, что в результате опроса посетителей магазинов одежды были получены ответы на следующие два вопроса. Какие факторы для Вас наиболее важны при выборе одежды? с вариантами ответа:

Приведем пример. Предположим, что в результате опроса посетителей магазинов одежды были получены ответы на следующие два вопроса. Какие факторы для Вас наиболее важны при выборе одежды? с вариантами ответа:

■ Высокое качество одежды.

■ Доступные цены.

■ Широта ассортимента одежды.

■ Близость к дому или работе.

■ Высокое качество обслуживания.

■ Красивый интерьер магазина.

Оцените, пожалуйста, следующие характеристики данного магазина одежды (в котором происходит опрос) по пятибалльной шкале (от 1 — очень плохо до 5 — отлично) с вариантами ответа:

■ Высокое качество одежды.

■ Доступные цены.

■ Широта ассортимента одежды.

■ Близость к дому или работе.

■ Высокое качество обслуживания.

■ Красивый интерьер магазина.

■ Ваша общая оценка работы данного магазина.

Над результатами второго вопроса был проведен множественный линейный регрессионный анализ. Анализировалось влияние оценок частных параметров всех исследованных магазинов одежды на их общую оценку. В разделе 4.3 подробно рассматривается процедура линейного регрессионного анализа, позволяющая, в частности, построить ранжированный перечень частных параметров по силе их влияния на общую оценку.

В разделе 4.3 подробно рассматривается процедура линейного регрессионного анализа, позволяющая, в частности, построить ранжированный перечень частных параметров по силе их влияния на общую оценку.

Таким образом, были получены два ранжированных списка с одинаковыми категориями: две схемы выбора магазина одежды. Затем оба списка были введены в SPSS под кодами, представленными выше: от 1 (наиболее важный фактор) до 6 (наименее важный фактор) (рис. 4.19). На рис. 4.20 представлены данные списки в мнемонической форме. Первый список представлен в переменной sc_l; второй — в sc_2.

|

|

Как вы видите на рис. 4.20, две схемы выбора, составленные на основании прямого метода (вопрос 1) и на основании регрессионного анализа (вопрос 2), соответствуют друг другу не полностью, различаясь в порядке следования первой и второй категорий. Проанализируем эти схемы выбора магазинов одежды на предмет соответствия при помощи коэффициента корреляции Спирмана.

Для этого снова откройте диалоговое окно Bi variate Correlations, выбрав пункт меню Analyze ► Correlate ► Bivariate. Перенесите две интересующие нас переменные — Схема №1 (составленная по вопросу 1) и Схема №2 (составленная по вопросу 2) — из левого списка всех доступных переменных в область Variables (рис. 4.21). Отмените вывод корреляции Пирсона и вместо него выберите параметр Spearman (корреляция Спирмана). После этого начните расчет при помощи щелчка на кнопке ОК.

|

В окне SPSS Viewer появится таблица Correlations с результатами расчета коэффициента ранговой корреляции (Спирмана) по двум анализируемым переменным. Как следует из рис. 4.22, две рассматриваемые схемы выбора различаются несущественно. Данный вывод можно сделать из сильной корреляции между переменными sc_l и sc_2 (коэффициент корреляции Спирмана = 0,9), характеризующейся весьма высокой статистической значимостью (0,005).

|

В заключение напомним, что ранговый коэффициент корреляции Спирмана (в отличие от Кендала) может применяться и в качестве аналога корреляции Пирсона при исследовании зависимостей между переменными, не приводимыми к интервальному виду и потому не являющимися ранжированными списками. В качестве примера можно привести гипотетический случай, рассмотренный выше, когда анализируется влияние пола респондентов (дихотомическая шкала) на уровень образования (порядковая по сути, но номинальная по виду шкала).

| < Предыдущая | Следующая > |

|---|

Коэффициенты корреляции

Посмотрите на табл.2. Испытуемые (всего их здесь 8) существенно отличаются друг от друга. Отличаются как по времени, которое потребовалось им для решения задач, так и по количеству правильных ответов. Есть информация о коммуникабельности испытуемых и о времени, которое они затратили на подготовку к решению задач. Необходимо проверить корреляционные связи между этими 4-мя переменными.

Измените имена переменных и введите данные в файл Sav. Сохраните файл под именем Корреляция.sav. Откройте меню для вычисления двумерных коэффициентов корреляции Analyze > Correlate > Bivariate…

Ограничения. Коэффициенты Пирсона (Pearson), Кендалла (Kendall’s tau—b) и Спирмена (Spearmen) не случайно помещены в одно меню: все они используются для проверки корреляционных связей между двумя числовыми переменными. Однако, коэффициент корреляции Пирсона является параметрическим. Следовательно, требует соблюдения известных условий: большая выборка, метрические переменные, нормальное распределение. Т.е. для анализа данных табл.2 его использование будет считаться некорректным. Но, если наша цель состоит только лишь в получении навыков работы в SPSS, то невыполнение условий можно сейчас считать неважным.

Коэффициенты корреляции и статистическая значимость. Включите все 4 переменные (variables) в анализ. Вычислите коэффициенты корреляции Пирсона и Спирмена с двусторонней (two—tailed) проверкой статистической значимости (это сочетание используется чаще всего). Ок.

Вы видите, что в файле Spo теперь есть 2 таблицы Correlations. Просмотрим вначале первую из них, размещенную в папке Correlations. Можно сразу же обратить внимание на комментарии под таблицей: звездочкой * помечены те коэффициенты корреляции, которые значимы на уровне 0,05. Двумя звездочками ** — значимые на уровне 0,01. Звездочки просто позволяют быстрее находить в корреляционной матрице статистически значимые связи. Вы видите, что на уровне 0,01 значима связь между Временем подготовки и Количеством правильных ответов. И действительно, мы видим, что уровень значимости этой связи Sig=0,009. На уровне 0,05 значима связь между Временем подготовки и Временем решения (Sig=0,013). Таким образом, связь между Временем подготовки и Количеством правильных ответов имеет более высокую статистическую значимость. Да, именно так: уровень статистической значимости меньше, а статистическая значимость при этом выше (многие вначале путаются с этой терминологией). Слабо готовые студенты часто решают задачу быстро, но с ошибками. Связь между Временем подготовки и Временем решения является менее сильной. Коэффициент корреляции (Pearson correlation) этой связи (-0,82) по модулю меньше, чем коэффициент корреляции между Временем подготовки и Количеством правильных ответов (0,84). Однако Вы видите, что одна связь является отрицательной, а другая – положительной. Конечно же, чем больше времени мы тратим на подготовку к решению задачи, тем быстрее мы потом решаем эту задачу и меньше совершаем ошибок.

В то же время Вы видите, что Коммуникабельность здесь не связана ни с Временем решения, ни с Количеством правильных ответов. Уровни значимости этих связей превышают критические значения. Соответственно и коэффициенты корреляции этих связей гораздо меньше (0,119 и -0,178). Видимо, это такая задача, решение которой зависит не столько от общительности, сколько от умений и знаний.

Посмотрите теперь коэффициенты корреляции Спирмена в папке Nonparametric correlations. Вы видите, что по Спирмену мы получили примерно те же результаты, однако связи являются чуть более слабыми, а статистическая значимость чуть менее высокой. Например, связь между Временем решения и Количеством правильных ответов оказалась значимой только лишь на уровне 0,05. Непараметрические методы обычно менее чувствительны по сравнению с параметрическими. Но остаются корректными независимо от шкалы измерения, нормальности распределения и размера выборки.

Диаграммы рассеяния. Наглядно представить связи между числовыми переменными позволяют диаграммы рассеяния. Откройте меню Graphs > Scatter/Dot… > Simple scatter > Define. Сделайте Время подготовки переменной горизонтальной оси (X axis), а Количество правильных ответов – переменной вертикальной оси (Y axis). Ок. Посмотрите: диаграмма не дает нам точной информации. Но мы сразу видим, что связь является сильной и положительной. Постройте также диаграммы рассеяния и для связей «ВремяПодготовки * ВремяРешения» и «Коммуникабельность*КоличествоПравильных». Мы сразу же видим, что первая из них является достаточно сильной и отрицательной, а вторая – достаточно слабой.

expect.ru

Корреляция Пирсона — Калькулятор коэффициентов линейной корреляции

Этот инструмент вычисляет коэффициент корреляции Пирсона данных.

Что такое корреляция Пирсона?

Вы когда-нибудь задумывались, влияют ли определенные вещи друг на друга? Например, если цены на газ вырастут при повышении дневной температуры?

Вы можете узнать с помощью корреляции Пирсона.

Для двух списков чисел возвращает значения от +1 до -1:

- 1: Y увеличивается с увеличением X.

- 0: Между переменными нет линейной корреляции.

- −1: Y уменьшается с увеличением X.

Коэффициент корреляции Пирсона обычно обозначается r, ρ Пирсона или просто ρ.

Как пользоваться этим калькулятором

- Для двух столбцов данных скопируйте и вставьте каждый в два текстовых поля.

- Или щелкните «Переключить один столбец», скопируйте два столбца и вставьте данные в текстовое поле.

Корреляция будет рассчитана автоматически.

API

pearsoncorrelation.com имеет простой API для расчета коэффициента корреляции Пирсона.

Конечная точка API

https://pearsoncorrelation.com/api/v2.groovy

Параметры

Один из

-

t, который содержит чередующийся список строк (одно значение первого столбца, одно значение второго столбца и т. Д.) -

t1иt2, которые содержат первый и второй столбцы соответственно

Используйте пробелы или символы новой строки для разделения значений.

Типы вывода

Вывод зависит от отправляемого вами заголовка Accept . Если вы отправите application / xml , вывод будет в формате XML. так же

для приложения / json (вывод JSON) и text / plain (вывод простого текста).

Режим JSON-P

Если вы используете параметр под названием callback , вы можете использовать API из удаленных доменов.

Pearson Product-Moment Correlation — Когда вы должны запустить этот тест, укажите диапазон значений, которые может принимать коэффициент, и способы измерения силы связи.

Что делает этот тест?

Коэффициент корреляции произведения-момента Пирсона (или для краткости коэффициент корреляции Пирсона) является мерой силы линейной связи между двумя переменными и обозначается как r . По сути, корреляция продукта-момента Пирсона пытается провести линию наилучшего соответствия по данным двух переменных, а коэффициент корреляции Пирсона, r , указывает, как далеко все эти точки данных находятся к этой линии наилучшего соответствия (i .е. насколько хорошо точки данных соответствуют этой новой модели / линии наилучшего соответствия).

Какие значения может принимать коэффициент корреляции Пирсона?

Коэффициент корреляции Пирсона, r , может принимать значения от +1 до -1. Значение 0 указывает на отсутствие связи между двумя переменными. Значение больше 0 указывает на положительную связь; то есть, по мере увеличения значения одной переменной, увеличивается и значение другой переменной. Значение меньше 0 указывает на отрицательную связь; то есть, когда значение одной переменной увеличивается, значение другой переменной уменьшается.Это показано на схеме ниже:

Как мы можем определить силу ассоциации на основе коэффициента корреляции Пирсона?

Чем сильнее связь двух переменных, тем ближе коэффициент корреляции Пирсона, r , будет либо к +1, либо к -1, в зависимости от того, положительная или отрицательная связь, соответственно. Достижение значения +1 или -1 означает, что все ваши точки данных включены в линию наилучшего соответствия — нет точек данных, которые показывают какие-либо отклонения от этой линии.Значения r между +1 и -1 (например, r = 0,8 или -0,4) указывают на то, что есть отклонения вокруг линии наилучшего соответствия. Чем ближе значение r к 0, тем больше отклонение от линии наилучшего соответствия. Различные отношения и их коэффициенты корреляции показаны на диаграмме ниже:

Существуют ли инструкции по интерпретации коэффициента корреляции Пирсона?

Да, были предложены следующие руководящие принципы:

| Коэффициент, r | ||

| Сила ассоциации | Положительно | Отрицательный |

| Малый | .1 к .3 | от -0,1 до -0,3 |

| Средний | от 0,3 до 0,5 | от -0,3 до -0,5 |

| Большой | .5 до 1.0 | от -0,5 до -1,0 |

Помните, что эти значения являются ориентировочными, и сильная связь также будет зависеть от того, что вы измеряете.

Можете ли вы использовать любой тип переменной для коэффициента корреляции Пирсона?

Нет, две переменные должны измеряться либо по шкале интервалов, либо по шкале отношений.Однако нет необходимости измерять обе переменные в одной шкале (например, одна переменная может быть соотношением, а другая — интервалом). Дополнительную информацию о типах переменных можно найти в нашем руководстве по типам переменных. Если у вас есть порядковые данные, вы захотите использовать корреляцию рангового порядка Спирмена или корреляцию Тау Кендалла вместо корреляции продукта Пирсона и момента.

Должны ли две переменные измеряться в одних и тех же единицах?

Нет, две переменные могут быть измерены в совершенно разных единицах.Например, вы можете соотнести возраст человека с его уровнем сахара в крови. Здесь агрегаты совершенно разные; возраст измеряется в годах, а уровень сахара в крови — в ммоль / л (мера концентрации). Действительно, расчеты коэффициента корреляции Пирсона были разработаны таким образом, что единицы измерения не влияют на расчет. Это позволяет сопоставить коэффициент корреляции и не зависеть от единиц используемых переменных.

А как насчет зависимых и независимых переменных?

Корреляция «произведение-момент» Пирсона не принимает во внимание, была ли переменная классифицирована как зависимая или независимая.Он одинаково обрабатывает все переменные. Например, вы можете узнать, коррелируют ли результаты в баскетболе с ростом человека. Поэтому вы можете построить график зависимости производительности от роста и рассчитать коэффициент корреляции Пирсона. Допустим, например, что r = 0,67. То есть с ростом роста растут и баскетбольные результаты. Это имеет смысл. Однако, если бы мы изобразили переменные наоборот и захотели определить, определяется ли рост человека его баскетбольными результатами (что не имеет смысла), мы все равно получим r =.67. Это потому, что коэффициент корреляции Пирсона не учитывает какую-либо теорию, объясняющую, почему вы выбрали две переменные для сравнения. Это показано ниже:

Указывает ли коэффициент корреляции Пирсона наклон линии?

Важно понимать, что коэффициент корреляции Пирсона, r , не представляет наклон линии наилучшего соответствия. Следовательно, если вы получаете коэффициент корреляции Пирсона +1, это не означает, что на каждую единицу увеличения одной переменной происходит увеличение другой единицы.Это просто означает, что нет различий между точками данных и линией наилучшего соответствия. Это показано ниже:

Какие допущения делает корреляция Пирсона?

Первый и наиболее важный шаг перед анализом ваших данных с использованием корреляции Пирсона — это проверить, уместно ли использовать этот статистический тест. В конце концов, корреляция Пирсона даст вам достоверных / точных результатов , только если ваш план исследования и данные « соответствует / соответствует » семи предположениям , которые лежат в основе корреляции Пирсона.

Во многих случаях корреляция Пирсона будет неправильным статистическим тестом , который следует использовать, потому что ваши данные « нарушают / не соответствуют » одному или нескольким из этих предположений. Это не редкость при работе с реальными данными, которые часто являются «беспорядочными», в отличие от примеров из учебников. Однако часто есть решение, будь то использование различных статистических тестов или внесение корректировок в ваши данные, чтобы вы могли продолжать использовать корреляцию Пирсона.

Мы кратко изложим семь предположений ниже, три из которых относятся к дизайну вашего исследования и способам измерения ваших переменных (например, Допущения №1, №2 и №3 ниже), а четыре относятся к характеристикам ваших данных ( т.е. предположения № 4, № 5, № 6 и № 7 ниже):

Примечание: мы перечисляем семь предположений ниже, но в статистической литературе существуют разногласия относительно того, следует ли использовать термин «допущения» для описания всех этих предположений (например, см. Nunnally, 1978). Мы выделяем этот момент для прозрачности.Однако мы используем слово «предположения», чтобы подчеркнуть их важность и указать, что их следует внимательно изучить при использовании корреляции Пирсона, если вы хотите получить точные / достоверные результаты. Мы также используем слово «предположения», чтобы указать, что там, где некоторые из них не выполняются, корреляция Пирсона больше не будет правильным статистическим тестом для анализа ваших данных.

- Допущение № 1: Две ваши переменные должны быть измерены по непрерывной шкале (т.е., они измеряются на интервале или на уровне отношения ). Примеры непрерывных переменных включают время проверки (измеряется в часах), интеллект (измеряется с помощью оценки IQ), успеваемость на экзамене (измеряется от 0 до 100), вес (измеряется в кг), скорость движения (измеряется в км / ч) и т. Д. .

- Предположение №2: Две непрерывные переменные должны быть парными , что означает, что каждый случай (например, каждый участник) имеет два значения: по одному для каждой переменной.Эти «значения» также называются «точками данных».

Например, представьте, что вы собрали время проверки (измеряется в часах) и результаты экзамена (измеряются от 0 до 100) от 100 случайно выбранных студентов в университете (т. Е. У вас есть две непрерывные переменные: «время проверки» и » сдача экзамена »). У каждого из 100 студентов будет время проверки (например, «студент №1» учился «23 часа») и результат экзамена (например, «студент №1» набрал «81 из 100»). Следовательно, у вас будет 100 парных значений.

- Допущение № 3: Должно быть случаев независимости , что означает, что два наблюдения для одного случая (например, баллы за время проверки и успеваемость на экзамене для «ученика №1») должны быть независимыми от два наблюдения для любого другого случая (например, баллы за время проверки и успеваемость на экзамене для «студента № 2», «студента № 3» или «студента № 50», например). Если наблюдения не являются независимыми , они связаны с , и корреляция Пирсона не является подходящим статистическим тестом (хотя есть и другие меры связи, которые можно использовать, когда у вас есть наблюдения, которые не являются независимыми).

Например, если некоторые из 100 студентов входили в группу для проверки, мы могли бы ожидать, что связь между временем проверки и успеваемостью этих студентов будет более схожей по сравнению с другими студентами, что нарушит допущение о независимости случаев. В качестве альтернативы, если в некоторых из 100 студентов были братья и сестры (например, две сестры), можно ожидать, что связь между временем проверки и успеваемостью этих двух сестер будет более похожей по сравнению с другими студентами, что опять же нарушит допущение о независимости случаев.

Примечание. Допущение независимости случаев также известно как предположение независимости наблюдений .

Поскольку предположения № 1, № 2 и № 3 относятся к вашему дизайну исследования , и тому, как вы, , измерили ваши переменные , если , то любое из этих трех предположений не выполнено (т. Е. Если какое-либо из этих предположения не соответствуют вашему исследованию), корреляция Пирсона — это неверный статистический тест для анализа ваших данных.Вероятно, вместо этого вы сможете использовать другие статистические тесты, но корреляция Пирсона не является правильным тестом.

После проверки того, соответствуют ли ваш план исследования и переменные предположениям № 1, № 2 и № 3 , теперь вы должны проверить, соответствуют ли ваши данные также предположениям № 4, № 5, № 6 и № 7 ниже. Проверяя, соответствуют ли ваши данные этим четырем предположениям, не удивляйтесь, если этот процесс займет большую часть времени, которое вы посвящаете проведению анализа.Как мы упоминали выше, нередко одно или несколько из этих предположений нарушаются (т.е.не выполняются) при работе с реальными данными, а не с примерами из учебников. Однако при правильном руководстве это не должно быть сложным процессом, и часто есть другие методы статистического анализа, которые вы можете применить, которые позволят вам продолжить анализ.

Примечание: если две ваши непрерывные парные переменные (т.е., Предположения № 4, № 5 и № 6 ниже; например, Lindeman et al., 1980). К сожалению, предположение о двумерной нормальности очень сложно проверить, поэтому вместо этого мы сосредотачиваемся на линейности и одномерной нормальности. Гомоскедастичность также сложно проверить, но мы включили это, чтобы вы знали, почему это важно. Мы включаем выбросы в конце (т. Е. Предположение № 7), потому что они не только приводят к нарушениям предположений линейности и одномерной нормальности, но также имеют большое влияние на значение коэффициента корреляции Пирсона, r (т.е.г., Wilcox, 2012).

- Предположение № 4: Между двумя непрерывными переменными должна быть линейная зависимость . Чтобы проверить, образуют ли ваши две переменные линейные отношения, вам просто нужно нанести их на график (например, диаграмму рассеяния) и визуально проверить форму графика. На диаграмме ниже вы найдете несколько различных примеров линейной связи и некоторые нелинейные отношения. Нецелесообразно анализировать нелинейную зависимость, используя корреляцию произведения-момента Пирсона.

Примечание. Коэффициент корреляции Пирсона — это мера силы линейной связи между двумя переменными. Другими словами, он определяет, существует ли линейный компонент связи между двумя непрерывными переменными. Таким образом, линейность не является строго «предположением» корреляции Пирсона. Однако обычно вы не хотите использовать корреляцию Пирсона для определения силы и направления линейной связи, если вы уже знаете, что связь между двумя вашими переменными не является линейной.Вместо этого связь между двумя вашими переменными может быть лучше описана другой статистической мерой (Cohen, 2013). По этой причине нередко просматривать взаимосвязь между двумя вашими переменными на диаграмме рассеяния, чтобы увидеть, является ли корреляция Пирсона лучшим выбором в качестве меры связи или другой показатель будет лучше.

- Предположение # 5: Теоретически обе непрерывные переменные должны подчиняться двумерному нормальному распределению , хотя на практике часто считается, что достаточно иметь одномерную нормальность в обеих переменных (т.е., каждая переменная имеет нормальное распределение). Когда одна или обе переменные являются , а не нормально распределенными, существует разногласие по поводу того, будет ли корреляция Пирсона по-прежнему давать действительный результат (т.е. есть разногласия по поводу того, является ли корреляция Пирсона « устойчивым » к нарушениям одномерной нормальности). Если вы делаете , а не принимаете аргументы о том, что корреляция Пирсона устойчива к отсутствию одномерной нормальности в одной или обеих переменных, вместо этого можно рассмотреть более надежных методов (например.г., см. Шевляков, Оя, 2016).

Примечание. Разногласия по поводу устойчивости корреляции Пирсона основаны на дополнительных предположениях , которые сделаны для того, чтобы оправдать устойчивость при ненормальности, а также на том, будут ли эти дополнительные предположения верными на практике. Дополнительную информацию по этому вопросу см., Например, в Edgell and Noon (1984) и Hogg and Craig (2014).

- Предположение № 6: Должно быть гомоскедастичности , что означает, что отклонения по линии наилучшего соответствия остаются похожими на по мере продвижения по линии.Если отклонения не похожи на , имеется гетероскедастичность . Гомоскедастичность проще всего продемонстрировать схематически, как показано ниже:

К сожалению, сложно проверить гомоскедастичность в корреляции Пирсона, но если вы считаете, что это может быть проблемой, есть методы, которые могут помочь (например, некоторые продвинутые методы см. В Wilcox, 2012). - Допущение № 7: Не должно быть одномерных или многомерных выбросов .Выброс — это наблюдение в вашей выборке, которое не соответствует шаблону, аналогичному остальным вашим данным. Помните, что в корреляции Пирсона каждый случай (например, каждый участник) будет иметь два значения / наблюдения (например, значение времени проверки и оценка экзамена). Вам необходимо учитывать выбросы, которые необычны только для одной переменной, известные как «одномерные выбросы», а также те, которые представляют собой необычную «комбинацию» обеих переменных, известную как «многомерные выбросы».

Рассмотрим пример времени проверки и оценки за экзамен.Если бы все студенты университета набрали на экзамене от 45% до 95%, за исключением одного, получившего очень низкие 5% на своем экзамене, этот человек был бы «одномерным» выбросом. То есть у них необычная оценка для этой конкретной переменной независимо от значений другой переменной — времени пересмотра. Многовариантный выброс — это выброс, который «противодействует тенденции» данных. Многомерный выброс не обязательно должен быть однофакторным выбросом. Предположим, что время, потраченное на проверку, положительно коррелирует с оценкой экзамена (т.е., чем больше учился студент, тем выше его оценка на экзамене). Если бы студент университета умер, почти не учась, но «сдав» экзамен, он был бы многомерным выбросом. И наоборот, если кто-то пересмотрел больше, чем большинство, но получил низкую оценку, это может быть многомерным выбросом.

Например, представьте, что один из 100 студентов университета набрал 5 из 100 на экзамене. Оценка за экзамен 5 из наших 100 была бы необычной по сравнению с остальными 99 студентами, в то время как остальные 99 студентов набрали где-то от 45 до 95 из 100 на своем экзамене.Следовательно, это будет «одномерный выброс». Другими словами, учащийся имеет необычный балл по этой конкретной переменной, «баллу за экзамен», независимо от того, какие значения он имел по другой переменной, «время проверки». В качестве альтернативы «многомерный выброс» — это выброс, который «противодействует тенденции» данных. Кроме того, многомерный выброс не обязательно должен быть одномерным выбросом. Поэтому предположим, что количество времени, которое студент тратит на проверку, положительно коррелирует с его оценкой на экзамене (т. Е. Чем больше студент учится, тем выше его оценка на экзамене).Если студент почти не пересматривал, но набрал наивысший балл на экзамене, это могло бы быть многомерным отклонением. И наоборот, если другой студент исправил больше, чем большинство, но получил плохую оценку, он также может оказаться многомерным выбросом.

Примечание: выбросы не обязательно являются «плохими», но из-за влияния, которое они оказывают на коэффициент корреляции Пирсона, r , обсуждаемый на следующей странице, их необходимо учитывать.

Вы можете проверить, соответствуют ли ваши данные предположениям № 4, № 5 и № 7, используя ряд пакетов статистики (чтобы узнать больше, см. Наши руководства для: SPSS Statistics, Stata и Minitab).Если какие-либо из этих семи предположений нарушены (т. Е. Не выполнены), часто есть другие методы статистического анализа, которые вы можете выполнить, которые позволят вам продолжить анализ (например, см. Шевляков и Оя, 2016) .

На следующей странице мы обсудим другие характеристики корреляции Пирсона, которые вам следует учитывать.

Главная О нас Связаться с нами Положения и условия Конфиденциальность и файлы cookie © Lund Research Ltd, 2018Корреляция продукта и момента Пирсона в SPSS Statistics

Введение

Коэффициент корреляции произведение-момент Пирсона (корреляция Пирсона, для краткости) — это мера силы и направления связи, которая существует между двумя переменными, измеренными по крайней мере на интервальной шкале.

Например, вы можете использовать корреляцию Пирсона, чтобы понять, существует ли связь между результатами экзамена и временем, затраченным на проверку. Вы также можете использовать корреляцию Пирсона, чтобы понять, существует ли связь между депрессией и продолжительностью безработицы.

Корреляция Пирсона пытается провести линию наилучшего соответствия по данным двух переменных, а коэффициент корреляции Пирсона, r , указывает, насколько далеко все эти точки данных находятся от этой линии наилучшего соответствия (т.е. насколько хорошо точки данных соответствуют этой модели / линии наилучшего соответствия). Вы можете узнать больше в нашем более общем руководстве по корреляции Пирсона, которое мы рекомендуем, если вы не знакомы с этим тестом.

Примечание. Если одна из двух ваших переменных является дихотомической, вы можете использовать вместо нее двухуровневую корреляцию, или, если у вас есть одна или несколько управляющих переменных, вы можете запустить частичную корреляцию Пирсона.

В этом «кратком руководстве» показано, как выполнить корреляцию Пирсона с помощью SPSS Statistics, а также интерпретировать и сообщать результаты этого теста.Однако, прежде чем мы познакомим вас с этой процедурой, вам необходимо понять различные предположения, которым должны соответствовать ваши данные, чтобы корреляция Пирсона дала вам достоверный результат. Мы обсудим эти предположения далее.

SPSS Statistics

Допущения

Когда вы решаете анализировать свои данные с помощью корреляции Пирсона, часть процесса включает проверку, чтобы убедиться, что данные, которые вы хотите проанализировать, действительно могут быть проанализированы с использованием корреляции Пирсона.Вам необходимо сделать это, потому что корреляция Пирсона уместна только в том случае, если ваши данные «соответствуют» четырем предположениям, которые необходимы для того, чтобы корреляция Пирсона дала вам достоверный результат. На практике проверка этих четырех предположений просто добавляет немного больше времени вашему анализу, требуя от вас щелкнуть еще несколько кнопок в SPSS Statistics при выполнении анализа, а также немного больше подумать о своих данных, но это действительно так. не сложная задача.

Прежде чем мы познакомим вас с этими четырьмя предположениями, не удивляйтесь, если при анализе ваших собственных данных с помощью SPSS Statistics одно или несколько из этих предположений будут нарушены (т.э., не встречается). Это не редкость при работе с реальными данными, а не с примерами из учебников, которые часто показывают вам, как выполнить корреляцию Пирсона, только когда все идет хорошо! Однако не волнуйтесь. Даже когда ваши данные не соответствуют определенным предположениям, часто есть решение, как это преодолеть. Во-первых, давайте посмотрим на эти четыре предположения:

- Предположение # 1: Две ваши переменные должны быть измерены в интервале или уровне отношения (т.е., они сплошные ). Примеры переменных, которые соответствуют этому критерию, включают время проверки (измеряется в часах), интеллект (измеряется с помощью оценки IQ), успеваемость на экзамене (измеряется от 0 до 100), вес (измеряется в кг) и т. Д. Вы можете узнать больше об интервальных и относительных переменных в нашем руководстве по типам переменных.

- Допущение № 2: Между двумя вашими переменными существует линейная зависимость . Хотя есть несколько способов проверить, существует ли линейная связь между двумя вашими переменными, мы предлагаем создать диаграмму рассеяния с помощью SPSS Statistics, где вы можете построить график одной переменной относительно другой переменной, а затем визуально проверить диаграмму рассеяния для проверки линейности .Ваша диаграмма рассеяния может выглядеть примерно так:

Если связь, отображаемая на диаграмме рассеяния, не является линейной, вам придется либо запустить непараметрический эквивалент корреляции Пирсона, либо преобразовать данные, что можно сделать с помощью SPSS Statistics. В наших расширенных руководствах мы покажем вам, как: (а) создать диаграмму рассеяния для проверки линейности при выполнении корреляции Пирсона с использованием SPSS Statistics; (б) интерпретировать различные результаты диаграммы рассеяния; и (c) преобразовать ваши данные с помощью SPSS Statistics, если между вашими двумя переменными нет линейной зависимости.Примечание. Корреляция Пирсона определяет степень линейности зависимости. Другими словами, он определяет, существует ли линейный компонент связи между двумя непрерывными переменными. Таким образом, линейность на самом деле не является предположением корреляции Пирсона. Однако обычно вы не захотите использовать корреляцию Пирсона для определения силы и направления линейной связи, если вы уже знаете, что связь между двумя вашими переменными не является линейной. Вместо этого связь между двумя вашими переменными может быть лучше описана другой статистической мерой.По этой причине нередко просматривать взаимосвязь между двумя вашими переменными на диаграмме рассеяния, чтобы увидеть, является ли корреляция Пирсона лучшим выбором в качестве меры связи или другой показатель будет лучше.

- Допущение № 3: Не должно быть значительных выбросов . Выбросы — это просто отдельные точки данных в ваших данных, которые не соответствуют обычному шаблону (например, в исследовании с оценкой IQ 100 студентов, где средний балл составлял 108 с небольшими вариациями между студентами, один студент имел оценку 156 , что очень необычно и может даже поставить ее в 1% лучших показателей IQ в мире).Следующие диаграммы рассеяния подчеркивают потенциальное влияние выбросов:

Коэффициент корреляции Пирсона, r , чувствителен к выбросам, которые могут иметь очень большое влияние на линию наилучшего соответствия и коэффициент корреляции Пирсона. Поэтому в некоторых случаях включение в анализ выбросов может привести к ошибочным результатам. Поэтому лучше, если нет выбросов или они сведены к минимуму. К счастью, при использовании SPSS Statistics для выполнения корреляции Пирсона для ваших данных вы можете легко включить процедуры для проверки выбросов.В нашем расширенном руководстве по корреляции Пирсона мы: (а) покажем вам, как обнаруживать выбросы с помощью диаграммы рассеяния, что является простым процессом при использовании SPSS Statistics; и (б) обсудить некоторые из доступных вам вариантов для работы с выбросами. - Предположение № 4: Ваши переменные должны быть приблизительно нормально распределенными . Чтобы оценить статистическую значимость корреляции Пирсона, вам необходимо иметь двумерную нормальность, но это предположение трудно оценить, поэтому чаще используется более простой метод.Этот более простой метод включает определение нормальности каждой переменной в отдельности. Для проверки нормальности вы можете использовать тест нормальности Шапиро-Уилка, который легко проверить с помощью SPSS Statistics. Помимо того, что мы покажем вам, как это сделать, в нашем расширенном руководстве по корреляции Пирсона, мы также объясним, что вы можете сделать, если ваши данные не соответствуют этому предположению.

Вы можете проверить предположения №2, №3 и №4 с помощью SPSS Statistics. Помните, что если вы не проверите эти предположения правильно, результаты, полученные при выполнении корреляции Пирсона, могут оказаться недействительными.Вот почему мы посвящаем ряд разделов нашего расширенного руководства по корреляции Пирсона, чтобы помочь вам понять это правильно. Вы можете узнать о нашем расширенном содержании на нашей странице Features: Overview , или, более конкретно, узнать, как мы помогаем с проверкой предположений на нашей странице Features: Ass Допущения .

В разделе «Процедура тестирования в SPSS Statistics» мы проиллюстрировали процедуру SPSS Statistics для выполнения корреляции Пирсона при условии, что никакие предположения не были нарушены.Сначала мы приводим пример, который используем для объяснения процедуры корреляции Пирсона в SPSS Statistics.

scipy.stats.pearsonr — Справочное руководство SciPy v1.5.4

Коэффициент корреляции Пирсона и p-значение для проверки отсутствия корреляции.

Коэффициент корреляции Пирсона [1] измеряет линейную зависимость между двумя наборами данных. Расчет p-значения основан на предположение, что каждый набор данных нормально распределен. (См. Ковальски [3] для обсуждения влияния ненормальности входа на распределение коэффициента корреляции.) Как и другие корреляции коэффициентов, этот варьируется от -1 до +1, где 0 означает отсутствие корреляция. Корреляция -1 или +1 подразумевает точную линейную зависимость. Положительные корреляции означают, что с увеличением x увеличивается и y. Отрицательный корреляции означают, что по мере увеличения x y уменьшается.

Значение p примерно указывает вероятность некоррелированной системы создание наборов данных, которые имеют корреляцию Пирсона не менее экстремальной как вычисленный из этих наборов данных.

- Параметры

- x (N,) array_like

Входной массив.

- y (N,) array_like

Входной массив.

- Возвращает

- r float

Коэффициент корреляции Пирсона.

- p-значение float

Двустороннее p-значение.

- Предупреждает

- PearsonRConstantInputWarning

Возникает, если вход является постоянным массивом. Коэффициент корреляции не определен в этом случае, поэтому

np.nanвозвращается.- PearsonRNearConstantInputWarning

Возникает, если вход «почти» постоянный. Считается массив

xпочти постоянная, еслиnorm (x - mean (x)) <1e-13 * abs (mean (x)). Числовые ошибки в расчетеx - среднее (x)в этом случае может приводят к неточному расчету r.

См. Также

-

Spearmanr Коэффициент ранговой корреляции Спирмена.2}} \]

, где \ (m_x \) - среднее значение вектора \ (x \), а \ (m_y \) - среднее значение вектора \ (y \).

В предположении, что x и y взяты из независимых нормалей распределений (так что коэффициент корреляции населения равен 0), функция плотности вероятности выборочного коэффициента корреляции r это ([1], [2]):

(1 - г ** 2) ** (п / 2 - 2) f (r) = --------------------- B (1/2, n / 2 - 1), где n - количество выборок, а B - бета-функция.Этот иногда называют точным распределением r. Это распределение, которое используется в

pearsonrдля вычисления p-значения. Распределение представляет собой бета-распределение на интервале [-1, 1], с равными параметрами формы a = b = n / 2 - 1. В терминах SciPy реализация бета-распределения, распределение r:dist = scipy.stats.beta (n / 2 - 1, n / 2 - 1, loc = -1, масштаб = 2)

p-значение, возвращаемое

pearsonr, является двусторонним p-значением.Для для данной выборки с коэффициентом корреляции r значение p равно вероятность того, что abs (r ’) случайной выборки x’ и y ’, взятой из популяция с нулевой корреляцией будет больше или равна в абс (г). В терминах объектаdist, показанного выше, значение p для данного r и длины n можно вычислить как:Когда n равно 2, указанное выше непрерывное распределение не является четко определенным. Предел бета-распределения можно интерпретировать как форму параметры a и b приближаются к a = b = 0 как дискретное распределение с равновероятные массы при r = 1 и r = -1.Более конкретно, один можно заметить, что, учитывая данные x = [x1, x2] и y = [y1, y2], и предполагая, что x1! = x2 и y1! = y2, единственные возможные значения для r равны 1 и -1. Поскольку abs (r ’) для любых выборок x’ и y ’длиной 2 будет равно 1, двустороннее p-значение для выборки длиной 2 всегда равно 1.

Список литературы

- 1 (1,2)

«Коэффициент корреляции Пирсона», Википедия, https://en.wikipedia.org/wiki/Pearson_correlation_coefficient

- 2

Студент, «Вероятная ошибка коэффициента корреляции», Биометрика, том 6, выпуск 2-3, 1 сентября 1908 г., стр.302-310.

- 3

К. Дж. Ковальский, “О влиянии ненормальности на распределение коэффициента корреляции образца продукта и момента » Журнал Королевского статистического общества. Серия C (применяется Статистика. 21, № 1 (1972), стр. 1–12.

Примеры

>>> из статистики импорта scipy >>> a = np.array ([0, 0, 0, 1, 1, 1, 1]) >>> b = np.arange (7) >>> stats.pearsonr (a, b) (0,8660254037844386, 0.011724811003954649)

>>> stats.pearsonr ([1, 2, 3, 4, 5], [10, 9, 2.5, 6, 4]) (-0,7426106572325057, 0,1505558088534455)

Корреляция Пирсона и Спирмена в Python

Понимание взаимосвязи между двумя или более переменными лежит в основе многих аспектов анализа данных или статистического анализа. Коэффициент корреляции или корреляции отражает связь между двумя переменными (в простейшем случае) численно.

Одной из часто используемых мер корреляции является коэффициент корреляции Пирсона.Другой часто используемой мерой корреляции является коэффициент корреляции Спирмена.

В этом посте мы увидим примеры вычисления корреляции Пирсона и Спирмена в Python сначала с использованием Pandas, Scikit Learn и NumPy.

Мы будем использовать данные системы оценки пробелов и вычислить корреляцию между gdpPercap и значениями ожидаемой продолжительности жизни из разных стран с течением времени. В этом случае можно ожидать, что продолжительность жизни будет увеличиваться по мере увеличения ВВП страны на душу населения.

Давайте выясним, как вычислить корреляцию Пирсона и Спирмена в Python.Давайте сначала загрузим необходимые пакеты

импортировать панд как pd импортировать numpy как np импортировать matplotlib.pyplot как plt импортировать seaborn как sns % matplotlib встроенный

Давайте загрузим данные gapminder как фрейм данных Pandas.

data_url = 'http://bit.ly/2cLzoxH' # читать данные с url как фреймворка pandas gapminder = pd.read_csv (data_url) # давайте выберем два соответствующих столбца gapminder = gapminder [['gdpPercap', 'lifeExp']] печать (пробел.голова (3)) gdpPercap lifeExp 0 779.445314 28.801 1 820,853030 30,332 2 853.100710 31.997Корреляция Пирсона

Корреляция Пирсона количественно определяет линейную связь между двумя переменными. Коэффициент корреляции Пирсона может находиться в диапазоне от -1 до +1, как и другие меры корреляции. Положительная корреляция Пирсона означает, что значение одной переменной увеличивается вместе с другими. А отрицательный коэффициент Пирсона означает, что одна переменная уменьшается, а другая - уменьшается.Коэффициенты корреляции -1 или +1 означают, что связь является строго линейной.

Корреляция Пирсона с пандами

Pandas предлагает функцию corr (), которую мы можем использовать с серией Pandas, как показано ниже. Мы видим, что gdpPercap и lifeExp положительно коррелируют, показывая, что увеличение gdpPercap увеличивает продолжительность жизни в целом.

gapminder.gdpPercap.corr (gapminder.lifeExp, method = "pearson") 0,5837062198659948

Корреляция Пирсона с NumPy

Мы также можем использовать NumPy для вычисления коэффициента корреляции Пирсона.Функция corrcoef () NumPy может принимать несколько переменных в виде двумерного массива NumPy и возвращать корреляционную матрицу.

np.corrcoef (gapminder.gdpPercap, gapminder.lifeExp)

В простейшем случае с двумя переменными он возвращает матрицу 2 × 2 со значениями корреляции Пирсона.

массив ([[1., 0.58370622], [0.58370622, 1.]])Корреляция Пирсона с SciPy

Мы также можем вычислить коэффициент корреляции Пирсона, используя модуль статистики SciPy.

из статистики импорта scipy gdpPercap = gapminder.gdpPercap.values life_exp = gapminder.lifeExp.values

В модуле статистикиSciPy есть функция pearsonr (), которая может принимать два массива NumPy и возвращать кортеж, содержащий коэффициент корреляции Пирсона и значимость корреляции как p-значение.

stats.pearsonr (gdpPercap, life_exp)

Первый элемент кортежа - это корреляция Пирсона, а второй - p-значение.

(0,5837062198659948, 3,565724241051659e-156)

Корреляция Спирмена

Корреляция Пирсона предполагает, что сравниваемые данные имеют нормальное распределение. Когда это предположение не соответствует действительности, значение корреляции отражает истинную связь. Корреляция Спирмена не предполагает, что данные взяты из определенного распределения, поэтому это непараметрическая мера корреляции. Корреляция Спирмена также известна как ранговая корреляция Спирмена, поскольку она вычисляет коэффициент корреляции по значениям ранга данных.

Корреляция Спирмена с пандами

Мы можем использовать функцию corr () с параметром method = "spearman" для вычисления корреляции Spearman с использованием Pandas.

gapminder.gdpPercap.corr (gapminder.lifeExp, method = "spearman")

Мы видим, что корреляция Спирмена выше корреляции Пирсона

0,8264711811970715

Корреляция Спирмена с NumPy

NumPy не имеет специальной функции для вычисления корреляции Спирмена.Однако мы можем использовать определение корреляции Спирмена, которая является корреляцией ранговых значений переменных. Мы в основном вычисляем ранг двух переменных и используем ранги с функцией корреляции Пирсона, доступной в NumPy.

gapminder ["gdpPercap_r"] = gapminder.gdpPercap.rank () gapminder ["lifeExp_r"] = gapminder.lifeExp.rank () gapminder.head ()

В этом примере мы создали две новые переменные, которые ранжируют исходные переменные и использовали их с функцией corrcoef () NumPy.

нп.corrcoef (gapminder.gdpPercap_r, gapminder.lifeExp_r)

Как мы видели ранее, это возвращает матрицу корреляции для всех переменных. И обратите внимание на результаты корреляции Спирмена из совпадений NumPy с athat из Pandas.

массив ([[1., 0.82647118], [0.82647118, 1.]])Корреляция Спирмена с SciPy

Используя SciPy, мы можем вычислить корреляцию Спирмена с помощью функции spearmanr (), и мы получим тот же результат, что и выше.

stats.spearmanr (gdpPercap, life_exp)

Понимание разницы между корреляцией Пирсона и Спирмена

Первое, что бросается в глаза при сравнении коэффициентов корреляции между gdpPercap и lifeExp, вычисленных с помощью коэффициентов корреляции Пирсона и Спирмена, - это большая разница между ними. Почему они разные? Мы можем понять разницу, если разберемся в предположениях каждого метода.

Как упоминалось ранее, корреляция Пирсона предполагает, что данные распределены нормально.Однако Спирмен не делает никаких предположений относительно распределения данных. Это основная причина разницы.

Проверим, нормально ли распределены переменные. Мы можем визуализировать распределения с помощью гистограммы. Построим гистограмму значений ожидаемой продолжительности жизни по данным гэпминдера.

hplot = sns.distplot (gapminder ['lifeExp'], kde = False, color = 'blue', bins = 100) plt.title ('Ожидаемая продолжительность жизни', fontsize = 18) plt.xlabel ('Срок службы (лет)', fontsize = 16) plt.ylabel ('Частота', размер шрифта = 16) plot_file_name = "gapminder_life_expectancy_histogram.jpg" # сохранить как jpeg hplot.figure.savefig (имя_файла_построения, format = 'jpeg', dpi = 100)Вот распределение ожидаемой продолжительности жизни, и мы ясно видим, что оно не распределяется нормально. Здесь не показано, но дистрибутив gdPercap обычно не распространяется. Следовательно, предположение о коэффициенте корреляции Пирсона явно нарушается и может объяснить разницу, которую мы видим.

Распределение значений ожидаемой продолжительности жизни на основе данных гэпаКроме того, корреляция Пирсона фиксирует силу линейной зависимости между двумя переменными. Однако ранговая корреляция Спирмена также может фиксировать нелинейную связь. Если мы посмотрим на диаграмму рассеяния связи между gdpPercap и lifeExp, мы увидим, что связь не является линейной. И этим тоже можно объяснить разницу.

sns.scatterplot ('lifeExp', 'gdpPercap', data = gapminder) plt.название ('lifeExp vs gdpPercap', fontsize = 18) plt.ylabel ('gdpPercap', fontsize = 16) plt.xlabel ('lifeExp', размер шрифта = 16)Нелинейная связь между gdpPercap и lifeExpКак сообщить коэффициент корреляции Пирсона (коэффициент корреляции) в стиле APA

APA имеет четкие требования к сообщению результатов статистических тестов, что означает, что, помимо правильного базового формата, вам необходимо обратить внимание на размещение скобок, пунктуацию, курсив и т. Д.

К счастью, основной формат цитирования r Пирсона не слишком сложен, как вы можете видеть здесь (красный цвет означает, что вы подставляете соответствующее значение из своего исследования).

r (степень свободы) = статистика r , p = p значение.

Пример

Представьте, что мы провели исследование с 40 студентами, в ходе которого выяснялось, коррелируются ли результаты IQ и средний балл.Мы можем сообщить о результатах следующим образом:

IQ и GPA оказались умеренно положительно коррелированными: r (38) = 0,34, p = 0,032.

Другие примеры

Установлено, что переменные размера и роста обуви сильно коррелированы: r (128) = 0,89, p <0,01.

Среди студентов Университета Хогвартс количество часов игры в Fortnite в неделю и результаты промежуточных экзаменов коррелировали отрицательно, r (78) = -.45, с. <.001.

Банкноты

Вот некоторые вещи, на которые следует обратить внимание.

1. Есть два способа сообщить значения p . Первый способ - указать альфа-значение, как во втором примере выше. Второй способ, очень предпочтительный в эпоху компьютерных вычислений (и способ, рекомендуемый APA), - это сообщить точное значение p (как в нашем основном примере). Если вы сообщаете точное значение p , то вам необходимо указать свой альфа-уровень в начале раздела результатов.Также следует отметить, что если ваше значение p меньше 0,001, то принято просто указать p <0,001, а не указывать точное значение.

2. Статистика r должна быть указана с 2 десятичными знаками.

3. Не забудьте отбросить ведущий 0 из значений r и p (т.е. не 0,34, а, скорее, 0,34).

4. Вам не нужно предоставлять формулу для r .

5.Степень свободы для r составляет N - 2 (количество точек данных минус 2).

.

4.20. Окно SPSS Data Editor с двумя ранжированными перечнями наиболее значимых для респондентов факторов выбора магазинов одежды одежды

4.20. Окно SPSS Data Editor с двумя ранжированными перечнями наиболее значимых для респондентов факторов выбора магазинов одежды одежды